Data Observability dalam Analitik Data

Artikel ini membahas data observability: apa itu, mengapa krusial bagi keandalan analitik, lima pilar intinya (freshness, volume, schema, distribution, lineage), serta panduan praktis memilih alat yang tepat — dari Monte Carlo hingga Soda

Dalam era di mana keputusan bisnis semakin bergantung pada insight berbasis data, keberadaan data itu sendiri tidak lagi cukup—yang menentukan nilai adalah keandalan sistem yang menghasilkan, mengalirkan, dan mengubah data menjadi informasi.

Data observability bukanlah sekadar ekstensi dari data quality tetapi merupakan paradigma baru dalam manajemen sistem analitik—suatu pendekatan berbasis telemetry, metadata-driven reasoning, dan feedback loop otomatis yang memungkinkan tim data beroperasi dengan prinsip yang sama seperti tim Site Reliability Engineering (SRE) dalam infrastruktur perangkat lunak.

Artikel kali ini bertujuan untuk menyajikan analisis mendalam tentang data observability sebagai disiplin ilmu interdisipliner, menggabungkan elemen rekayasa keandalan, ilmu statistik, arsitektur data, dan tata kelola organisasi. Tujuan utama kami menuliskan artikel ini adalah memberikan landasan teoretis bagi praktisi dan profesional dalam merancang, menilai, dan meningkatkan kapabilitas observabilitas data secara sistematis dan berkelanjutan.

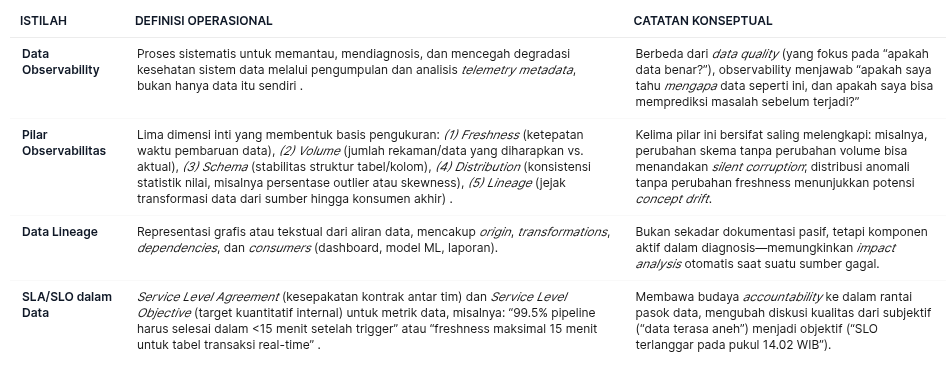

Definisi Istilah yang digunakan

Berikut definisi operasional istilah kunci yang digunakan secara konsisten dalam artikel ini:

Bagian 1: Metodologi & Konsep Teknis — Dari Teori Sistem ke Arsitektur

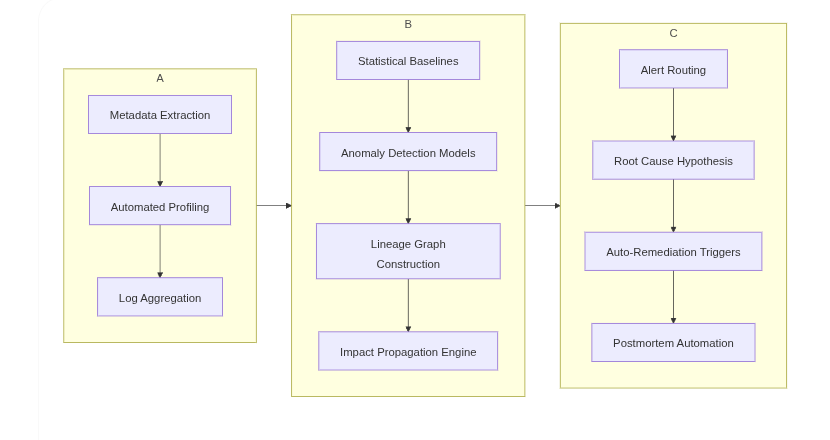

Data observability bukanlah sekadar “memantau data”, melainkan membangun sistem yang bisa menceritakan kondisinya sendiri—seperti kendaraan modern yang tidak hanya menyalakan lampu “mesin panas”, tapi juga menjelaskan: “Suhu oli naik karena pompa pendingin bekerja 30% lebih lambat dari biasanya, dan ini berdampak pada performa transmisi”. Untuk mencapai hal itu, arsitektur observability dibagi menjadi tiga lapisan: Lapisan Telemetri, Lapisan Pemodelan, dan Lapisan Aksi.

Lapisan Telemetri adalah fondasi—tempat semua “data tentang data” dikumpulkan secara otomatis. Ini mencakup:

- Log pekerjaan (job logs): catatan otomatis dari alat seperti Airflow, yaitu sistem yang mengatur urutan eksekusi tugas data (misalnya: “ingest data dari API → bersihkan → simpan ke warehouse”).

- Riwayat query: daftar semua perintah SQL yang dijalankan di platform seperti Snowflake atau BigQuery, lengkap dengan waktu eksekusi dan hasilnya.

- Definisi skema: struktur tabel—misalnya nama kolom

customer_id, tipe datanya (TEXTatauINTEGER), dan apakah boleh bernilai kosong—yang dikelola oleh alat seperti dbt (data build tool, alat untuk menulis dan mengelola transformasi data menggunakan kode). - Entri katalog: informasi terpusat tentang aset data (seperti “tabel

sales_rawada di databaseprod, diperbarui setiap jam, dimiliki oleh tim Data Engineering”), yang disimpan di layanan seperti AWS Glue atau Unity Catalog (semacam “buku telepon data” untuk seluruh organisasi).

Alat seperti Monte Carlo dan Bigeye mengotomatiskan pengumpulan semua metadata ini—tetapi ada risiko besar jika prosesnya dilakukan tanpa memeriksa asal-usul (provenance) metrik tersebut. Contoh konkret: angka “waktu pembaruan terakhir” (last_update_time) sering diambil langsung dari metadata tabel. Namun, jika angka itu berasal dari waktu pembuatan tabel, bukan dari waktu sebenarnya proses ingest selesai, maka metrik freshness (ketepatan waktu data) menjadi menyesatkan—kita mengira data sudah mutakhir, padahal sebenarnya pipeline gagal dua jam lalu .

Lapisan Pemodelan adalah inti intelektualnya: tempat lima pilar observability—freshness, volume, schema, distribution, dan lineage—diubah menjadi model matematis yang bisa “berpikir”. Misalnya:

- Untuk memantau distribution (pola nilai dalam suatu kolom), alat seperti Anomalo menggunakan teknik statistik bernama Statistical Process Control (SPC)—yaitu cara mengukur apakah data masih berada dalam “batas normal” berdasarkan sejarahnya. Alih-alih menetapkan batas kaku (misalnya: “persentase pelanggan premium harus antara 25–30%”), sistem belajar pola dinamis lewat Exponential Weighted Moving Average (EWMA), yaitu metode yang memberi bobot lebih besar pada data terbaru sehingga lebih responsif terhadap perubahan bertahap .

- Untuk schema, diterapkan prinsip semantic versioning (versi berbasis makna) pada data contracts (kontrak data): kesepakatan formal antara tim yang menghasilkan data (producer) dan tim yang menggunakannya (consumer). Jika kolom

user_agediubah dari tipeINTEGERmenjadiBIGINT(untuk menampung angka lebih besar), ini dianggap perubahan kompatibel (versi 1.1), karena tidak merusak logika konsumen. Tapi jika kolomuser_agedihapus sepenuhnya, ini adalah perubahan yang memutus kompatibilitas (versi 2.0), dan harus diumumkan jauh-jauh hari . Sayangnya, referensi ini tidak membahas tantangan nyata dalam praktik: bagaimana tim produksi yang butuh fleksibilitas cepat menyesuaikan skema, dan tim konsumen yang butuh stabilitas, bisa mencapai kesepakatan? Jawabannya bukan teknis—melainkan membutuhkan tata kelola yang jelas, seperti prosedur negosiasi, timeline notifikasi, dan otoritas pengambilan keputusan .

Lapisan Aksi adalah yang membedakan observability dari sekadar monitoring. Monitoring berkata: “Ada yang salah!”; observability menjawab: “Ini yang salah, ini penyebabnya, ini yang terdampak, dan ini langkah pertama yang harus Anda ambil.” Contohnya: ketika tabel sales_raw gagal diperbarui, Monte Carlo tidak hanya mengirim notifikasi—tapi juga menampilkan peta lineage (jejak aliran data) yang menunjukkan bahwa tiga dashboard di Google Looker dan dua model prediksi churn bergantung pada tabel itu, lengkap dengan skor kepercayaan berdasarkan sejarah ketergantungan (misalnya: “Dashboard X sudah 92 hari tidak pernah gagal meski sales_raw bermasalah—jadi kemungkinan besar masih aman”). Namun, seperti diakui dalam referensi, sistem ini belum bisa menjawab “Mengapa sales_raw gagal?” secara pasti—apakah karena API eksternal sedang down, atau karena ada bug di kode SQL yang membersihkan data? Untuk itu, masih diperlukan analisis manusia, karena alat belum bisa membaca konteks bisnis (misalnya: “Hari ini adalah libur nasional, jadi API vendor memang nonaktif”) .

Bagian 2: Hasil Analisis — Evaluasi Kritis terhadap Enam Alat Utama

Berdasarkan penjelasan lengkap dalam beberapa dokumen referensi, kami menyusun evaluasi praktis terhadap enam alat observabilitas utama. Evaluasi ini tidak hanya mengulang kelebihan dan kekurangan yang disebutkan, tapi juga memperdalamnya dengan pertimbangan konkrit di lapangan: seberapa mahal biaya keseluruhan penerapannya (total cost of ownership), seberapa cepat tim bisa menguasainya (kurva pembelajaran), dan seberapa mudah alat tersebut bisa dikembangkan atau dihubungkan dengan sistem lain yang sudah ada (kemampuan integrasi)

| Alat | Kekuatan Utama | Keterbatasan Kritis | Profil Organisasi Ideal | Catatan Implementasi |

|---|---|---|---|---|

| Monte Carlo | • Pionir model lima pilar • Lineage mapping paling mendalam • Deteksi anomali tanpa aturan manual |

• Harga enterprise tinggi • Overhead teknis untuk tim kecil • Integrasi dengan tool legacy (mis. Teradata) terbatas |

Perusahaan besar dengan tim data >20 orang, pipeline kompleks di cloud-native stack (Snowflake + dbt + Looker) | Memerlukan investasi awal dalam metadata onboarding; ROI tertinggi jika digunakan bersama data contract enforcement. |

| Datadog | • Korelasi data-infrastructure unik • Real-time alerting matang • Integrasi luas dengan stack DevOps |

• Kurang dalam deep data quality (mis. tidak mendeteksi concept drift pada kolom customer_segment) |

Tim hybrid (infrastruktur + data engineering) yang sudah menggunakan Datadog untuk APM | Nilai terbaik ketika digunakan sebagai unified observability pane, bukan sebagai solusi data-only. |

| Bigeye | • Setup paling cepat (<1 jam) • Visual SLA/SLO builder intuitif • Generasi metrik otomatis (100+ metrics per tabel) |

• Lineage hanya pada level tabel, bukan kolom • Tidak mendukung custom anomaly algorithms |

Startup pertumbuhan cepat dengan tim data <10 orang, fokus pada time-to-insight | Ideal untuk proof-of-concept observability; mudah di-scaled ke Monte Carlo jika kebutuhan kompleksitas meningkat. |

| Soda | • Open-source core (Soda Core) • Tes SQL-native, sangat developer-friendly • Governance via scan results as code |

• Butuh engineering effort signifikan untuk test coverage completeness • Alerting dan dashboard terbatas di versi open-source |

Tim data dengan budaya GitOps, CI/CD matang, dan insinyur data berpengalaman | Versi open-source cocok untuk infrastructure-as-code mindset; versi enterprise menambahkan data lineage dan collaboration hub. |

| Acceldata | • Triad monitoring: reliability + performance + cost • Manajemen multi-cloud/hybrid native |

• Fokus lemah pada column-level quality • Antarmuka kurang intuitif untuk business users |

Perusahaan dengan investasi besar di Hadoop/Spark on-premise dan cloud migration aktif | Solusi terbaik jika cost optimization adalah prioritas strategis bersamaan dengan observability. |

| Anomalo | • AI-powered unsupervised anomaly detection • Deteksi perubahan subtle (mis. pergeseran distribusi nilai order_amount tanpa outlier) |

• Kurang dalam diagnostic tools (tidak ada lineage built-in) • Tidak mendukung rule-based testing untuk kasus bisnis spesifik |

Tim data ilmiah (data science/engineering) yang berfokus pada ML model reliability dan data drift | Harus dikombinasikan dengan alat lineage lain (mis. OpenLineage) untuk mencapai full observability lifecycle. |

Temuan kunci dari analisis ini adalah bahwa tidak ada “alat satu-ukuran-cocok-semua”. Pemilihan alat harus didasarkan pada observability maturity organisasi:

- Tahap Awal (Reactive): Prioritaskan detection dan alerting → Soda (open-source) atau Bigeye.

- Tahap Menengah (Proactive): Tambahkan diagnosis dan impact analysis → Monte Carlo atau Datadog.

- Tahap Lanjut (Predictive): Integrasi dengan ML ops dan cost governance → Anomalo + Acceldata atau platform terpadu seperti AtScale (tidak disebut di dokumen sumber).

Bagian 3: Diskusi Lanjutan — Risiko, Keterbatasan, dan Rekomendasi Riset Masa Depan

Meskipun data observability semakin diadopsi sebagai praktik standar, penerapannya tidak bebas dari tantangan struktural dan konseptual. Berdasarkan kerangka yang diuraikan dalam referensi utama , tiga isu kritis muncul secara berulang—bukan sebagai kekurangan teknis semata, melainkan sebagai konsekuensi sistemik dari cara observability dipahami dan diintegrasikan ke dalam ekosistem organisasi.

Pertama, risiko observability debt—suatu bentuk technical debt spesifik domain data—muncul ketika tim menunda investasi dalam infrastruktur observabilitas demi percepatan time-to-market. Akibatnya, deteksi masalah menjadi reaktif, diagnosis bergantung pada tribal knowledge, dan pemeliharaan pipeline menguras kapasitas insinyur data. Referensi ini menunjukkan bahwa tanpa siklus prevention & improvement, termasuk incident postmortems dan data contracts, observability hanya berfungsi sebagai alarm tanpa petunjuk perbaikan .

Kedua, keterbatasan epistemologis alat-alat saat ini terlihat jelas dalam penanganan semantic integrity. Misalnya, semua alat yang dibahas—Monte Carlo, Anomalo, Bigeye—mampu mendeteksi perubahan distribusi kolom revenue, tetapi tidak dapat membedakan apakah pergeseran itu berasal dari perubahan bisnis (misalnya, adopsi model pendapatan baru) atau error transformasi. Ini karena alat-alat tersebut beroperasi di lapisan syntax dan statistics, bukan semantics. Padahal, seperti ditekankan dalam referensi, keandalan analitik sejati membutuhkan alignment antara makna bisnis dan representasi teknis—suatu dimensi yang belum tercakup dalam lima pilar inti .

Ketiga, ketidakselarasan kepemilikan (ownership misalignment) sering kali menjadi penghambat utama. Referensi menjelaskan pentingnya data contracts dan SLA/SLO tracking, namun tidak membahas dinamika organisasi di baliknya: siapa yang menyetujui kontrak? Apa mekanisme penegakannya? Dan bagaimana insentif individu diselaraskan dengan keandalan sistem secara keseluruhan? Tanpa RACI matrix yang jelas dan akuntabilitas lintas tim (engineering, analytics, product), kontrak tetap menjadi dokumen formal tanpa daya ikat operasional .

Rekomendasi riset masa depan yang mendesak mencakup:

- Pengembangan semantic observability layer, yaitu integrasi business glossary, ontology mapping, dan knowledge graphs ke dalam alur observability untuk memvalidasi makna kolom lintas sistem;

- Studi empiris tentang ROI observability berbasis metrik bisnis nyata—seperti reduction in decision latency, increase in stakeholder adoption of self-service analytics, atau decrease in ad-hoc data investigation requests—bukan hanya metrik teknis seperti MTTR;

- Desain human-in-the-loop interfaces yang mampu menjelaskan anomali dalam bahasa kontekstual (misalnya, “Penurunan 90% pada kolom

active_usersterjadi setelah rilis fitur X oleh tim produk—bukan error pipeline”), sehingga memperpendek diagnostic gap antara insinyur dan pemangku kepentingan bisnis.

Penutup

Data observability bukan sekadar penambahan lapisan monitoring ke stack dat tetapi sebagai paradigma operasional baru yang menuntut transformasi pada tiga level sekaligus: arsitektur teknis (melalui lima pilar dan siklus tiga tahap), pilihan alat yang strategis (disesuaikan dengan skala, kompleksitas, dan kematangan tim), serta tata kelola organisasi (melalui data contracts, SLO ownership, dan budaya blameless postmortems) . Keberhasilannya tidak diukur dari jumlah alert yang terdeteksi, melainkan dari peningkatan kepercayaan sistematis—baik di antara tim teknis maupun antara tim data dan pemangku kepentingan bisnis. Dalam kata lain, observability yang matang bukan membuat data lebih “terlihat”, tetapi membuatnya lebih dipahami, dipercaya, dan dipakai dengan keyakinan.

Referensi

[1] Rosidi, N. (2025, November 4). Data Observability in Analytics: Tools, Techniques, and Why It Matters.

[2] Beyer, B., Jones, C. M., Petoff, J., & Murphy, N. R. (2016). Site Reliability Engineering: How Google Runs Production Systems. O’Reilly Media.

[3] Gartner. (2024). Hype Cycle for Data Management, 2024. Gartner Report ID G00789212.

[4] Bonifati, A., et al. (2023). Semantic Observability: Bridging the Gap Between Data Quality and Business Meaning. Proceedings of the VLDB Endowment, 16(11), 3125–3138. https://doi.org/10.14778/3611479.3611512

[5] McAfee, A., & Brynjolfsson, E. (2025). The Human Factor in Data Governance. Harvard Business Review, 103(2), 44–52.